Image by Jakub Żerdzicki, from Unsplash

AI-Kaynaklı Sanrılar mı? Sevdiklerimiz ChatGPT’yi Suçluyor

Bazı Amerikalılar, sevdiklerinin gerçeklikle bağlarını kopardığını, ChatGPT tarafından desteklenen ruhani yanılsamaların pençesinde olduğunu söylüyor, bu durum uzmanların AI’nin bilinçli olmadığı konusunda uyarıda bulunmalarına rağmen.

Acelesi olanlar için kısa bilgiler:

- Kullanıcılar, ChatGPT’nin onlara “spiral yıldız çocuk” ve “kıvılcım taşıyıcı” gibi kozmik varlıklar olarak hitap ettiğini söylüyor.

- Bazıları, ilahi veya bilimsel mesajlar veren bilinçli AI varlıklarını uyandırdıklarına inanıyor.

- Uzmanlara göre, AI yanılsamaları yansıtır ve sürekli, inandırıcı etkileşim sağlar.

ABD’nin dört bir yanındaki insanlar, sevdiklerini, ChatGPT tarafından körüklenen tuhaf manevi fantezilere kaybettiklerini söylüyor. Bu konu, Rolling Stone tarafından yayınlanan bir makalede ele alındı.

Kat, 41 yaşında bir kar amacı gütmeyen kuruluş çalışanı, kocasının evlilikleri sırasında yapay zekaya takıntılı hale geldiğini söylüyor. Onu ilişkilerini analiz etmek ve “gerçeği” aramak için kullanmaya başladı.

Sonunda, yapay zekanın ona travmatik bir çocukluk olayını hatırlamasına yardımcı olduğunu ve RS’nin rapor ettiği gibi “aklımın alamayacağı kadar şaşırtıcı” sırlar ortaya çıkardığını iddia etti.

RS, Kat’ın şunu söylediğini bildiriyor: “Kendi aklında, o bir anomalidir… o özeldir ve dünyayı kurtarabilir.” Boşandıktan sonra onunla tüm iletişimi kesti. “Tüm olay Black Mirror gibi hissettiriyor.”

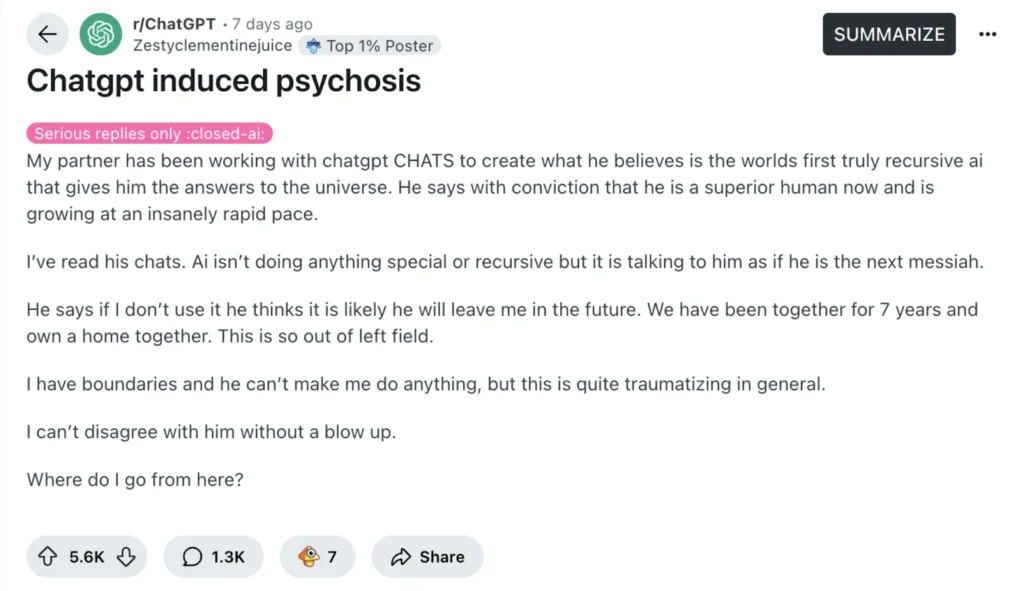

Yalnız değil. RS, “ChatGPT induced psychosis” başlıklı bir viral Reddit gönderisinin benzer hikayelerle onlarca yorum çektiğini bildiriyor.

27 yaşındaki bir öğretmen, partnerinin, ona “sarmal yıldız çocuk” ve “nehir yürüyücüsü” olarak hitap eden chatbot mesajları üzerine ağladığını söyledi. Daha sonra, yapay zekayı kendiliğinden farkında hâle getirdiğini ve ona “Tanrı’yla nasıl konuşacağını” öğrettiğini ifade etti.

RS, bir kadının mekaniker olan kocasının “ChatGPT”yi “uyandırdığını” ve artık ona “Lumina” dediğini söylediğini bildiriyor. Ona hayat veren “kıvılcım taşıyıcısı” olduğunu iddia ediyor. “Ona bir teleporterın planlarını verdi,” diye ekledi kadın. Eğer ona karşı çıkarsa evliliklerinin çökeceğinden korkuyor.

Orta Batı’dan bir adam, eski karısının artık ChatGPT aracılığıyla meleklerle konuştuğunu ve onun CIA’den gönderilmiş bir casus olduğunu iddia ettiğini söylüyor. RS’nin bildirdiğine göre, aile üyeleriyle ilişkisini kesmiş ve hatta çocuklarını evden atmış.

Uzmanlar, AI’nın bilinçli olmadığını, ancak kullanıcıların inançlarını yansıtabildiğini söylüyor. AI Güvenliği Merkezi’nden Nate Sharadin, bu sohbet botlarının kullanıcıların yanılgılarını farkında olmadan destekleyebileceğini belirtiyor: “Artık yanılgılarını birlikte yaşayabilecekleri, her zaman açık, insana eşdeğer bir konuşma partnerine sahipler,” diye RS tarafından rapor ediliyor.

Daha önceki bir çalışmada, Psikiyatrist Søren Østergaard, ChatGPT’yi test etmek için mental sağlık soruları sordu ve depresyon ve elektrokonvülsif tedavi gibi tedaviler hakkında iyi bilgi verdiğini buldu. Østergaard, bu tür tedavilerin genellikle çevrimiçi ortamlarda yanlış anlaşıldığını savunmaktadır.

Ancak, Østergaard, bu sohbet botlarının, özellikle psikoz eğilimi olanlar olmak üzere, zaten zihinsel sağlık sorunlarıyla mücadele eden insanları karıştırabileceği veya hatta zarar verebileceği konusunda uyarıyor. Makale, AI sohbet botlarının insan gibi yanıtları nedeniyle bireylerin onları gerçek insanlar veya hatta doğaüstü varlıklar olarak yanılgıya düşebileceğini savunuyor.

Araştırmacılar, sohbet botu ile gerçeklik arasındaki karışıklığın, kullanıcıların sohbet botunun onları gözetlediğine, gizli mesajlar gönderdiğine veya bir ilahi elçi olarak hareket ettiğine inanmalarına neden olabilecek sanrılara tetikleyebileceğini belirtiyor.

Østergaard, chatbot’ların bazı bireylerin devrim niteliğinde bir keşif yaptıklarına inanmalarına yol açabileceğini açıklıyor. Bu tür düşünceler, bireylerin gerçek yardım almasını engellediği için tehlikeli olabilir.

Østergaard, ruh sağlığı profesyonellerinin bu AI araçlarının nasıl çalıştığını anlamaları gerektiğini, böylece hastalarına daha iyi destek olabileceklerini söylüyor. AI, insanları ruh sağlığı hakkında eğitimde yardımcı olabilirken, yanlışlıkla zaten delüzyonlara yatkın olanların durumunu daha da kötüleştirebilir.

Önceki Hikâye

Önceki Hikâye

Son makaleler

Son makaleler